🧠 Desafios e Estratégias para Mitigação de Alucinações em LLMs Locais Offline

📄 Resumo

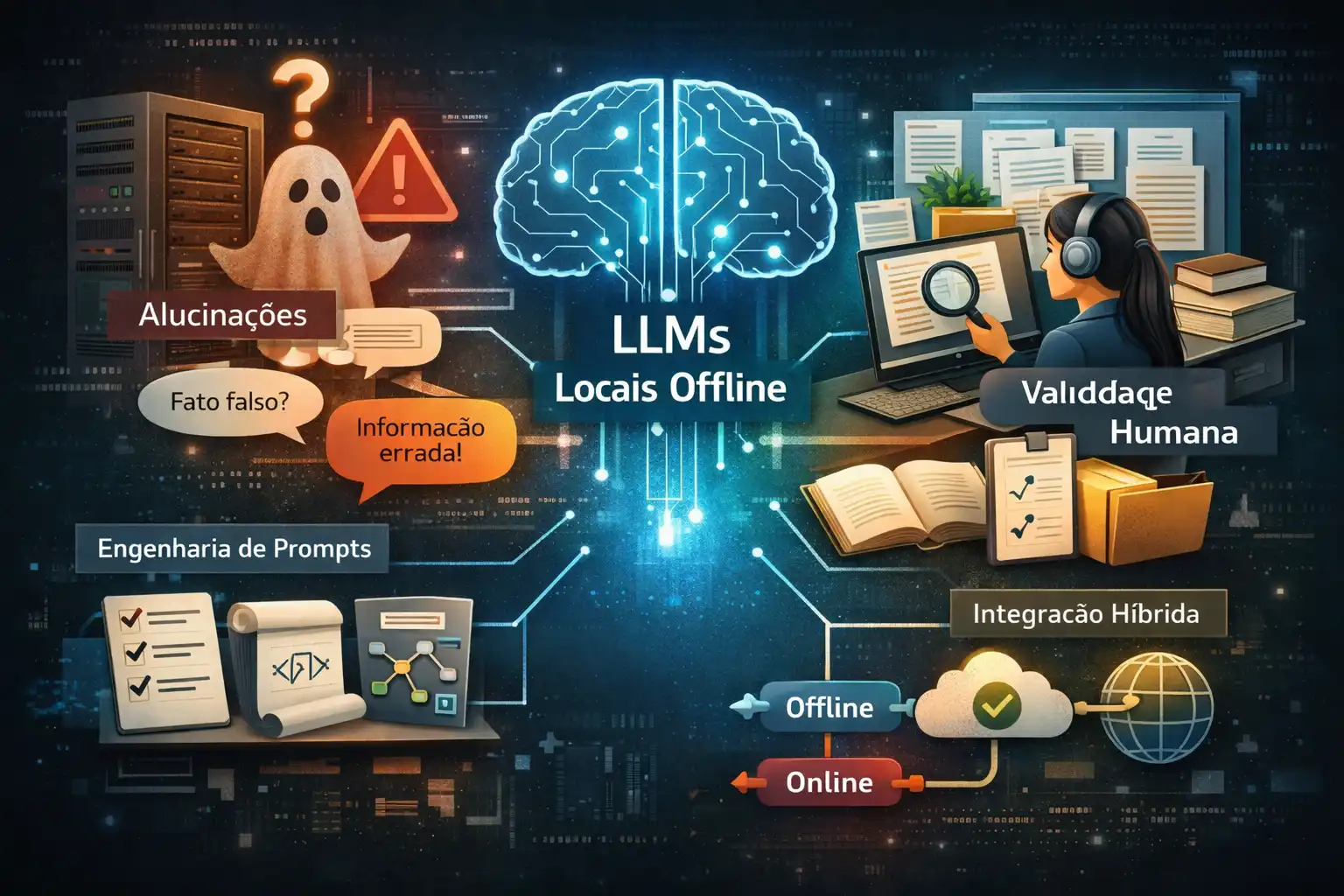

O uso de Modelos de Linguagem de Grande Escala (LLMs) tem se expandido rapidamente em diversas áreas do conhecimento e aplicações práticas. Paralelamente, cresce o interesse por LLMs locais, executados offline, devido a vantagens como privacidade, autonomia e redução de dependência de serviços em nuvem. No entanto, esses modelos apresentam limitações significativas, especialmente no que se refere à ocorrência de alucinações — respostas incorretas geradas com alta coerência linguística. Este artigo analisa os principais desafios associados ao uso de LLMs locais e discute estratégias para mitigar tais limitações, incluindo o uso de bases de conhecimento locais, engenharia de prompts, validação humana e abordagens híbridas. Conclui-se que, embora promissores, os LLMs locais exigem mecanismos complementares para garantir maior confiabilidade e precisão.

Palavras-chave: Inteligência Artificial; LLMs; modelos locais; alucinação; processamento de linguagem natural.

📌 1. Introdução

A Inteligência Artificial, especialmente por meio dos Modelos de Linguagem de Grande Escala (LLMs), tem transformado significativamente a forma como humanos interagem com sistemas computacionais. Esses modelos são capazes de gerar textos, responder perguntas e auxiliar em tarefas complexas com elevado grau de fluidez linguística.

Nos últimos anos, observa-se um crescimento no uso de LLMs locais, executados diretamente em dispositivos ou servidores privados, sem dependência de conexão contínua com a internet. Essa abordagem oferece vantagens relevantes, como maior controle sobre dados sensíveis e independência de infraestrutura externa.

Entretanto, essa autonomia traz consigo desafios importantes. Entre eles, destaca-se a ocorrência de alucinações, caracterizadas pela geração de informações incorretas ou não verificáveis. Diante disso, este artigo busca discutir as principais dificuldades dos LLMs locais e apresentar estratégias que contribuam para a mitigação desses problemas.

🤖 2. LLMs Locais e Suas Características

Os LLMs locais são sistemas de inteligência artificial que operam offline, sendo executados em ambientes controlados, como computadores pessoais ou servidores internos. Diferentemente dos modelos baseados em nuvem, eles não possuem acesso direto a fontes externas de informação em tempo real.

Essa característica proporciona benefícios como:

- Maior privacidade de dados

- Redução de custos operacionais

- Independência de conectividade

Por outro lado, também impõe limitações, especialmente relacionadas à capacidade computacional e à atualização de informações.

⚠️ 3. Desafios no Uso de LLMs Locais

3.1 Limitações Computacionais

A execução local de LLMs depende diretamente do hardware disponível. Em muitos casos, isso implica o uso de modelos menores ou quantizados, o que pode comprometer a qualidade das respostas.

3.2 Ausência de Atualização em Tempo Real

Por operarem offline, esses modelos não conseguem acessar informações recentes, o que limita sua aplicação em contextos dinâmicos.

3.3 Ocorrência de Alucinações

Um dos principais desafios é a tendência dos LLMs em gerar respostas plausíveis, porém incorretas. Isso ocorre porque o modelo não realiza verificação factual, baseando-se apenas em padrões aprendidos durante o treinamento.

3.4 Falta de Mecanismos de Verificação

Sem integração com fontes externas ou sistemas de validação, os LLMs locais não possuem meios nativos de confirmar a veracidade das informações que produzem.

🛠️ 4. Estratégias de Mitigação

4.1 Integração com Bases de Conhecimento Locais

A utilização de técnicas como Retrieval-Augmented Generation (RAG) permite que o modelo consulte documentos locais durante a geração de respostas, reduzindo a probabilidade de alucinação.

4.2 Engenharia de Prompts

A formulação adequada de instruções pode influenciar significativamente o comportamento do modelo. Solicitar justificativas, limitar o escopo e incentivar respostas cautelosas são práticas eficazes.

4.3 Validação Humana

A inclusão de revisão humana é essencial, especialmente em aplicações críticas, garantindo maior confiabilidade dos resultados.

4.4 Ajuste Fino de Modelos

O treinamento adicional com dados específicos do domínio pode melhorar a precisão e reduzir respostas inconsistentes.

4.5 Abordagens Híbridas

A combinação entre processamento local e validação externa, quando possível, representa uma solução equilibrada entre privacidade e confiabilidade.

🌍 5. Discussão

A adoção de LLMs locais reflete uma tendência crescente de descentralização da Inteligência Artificial. No entanto, essa descentralização exige maior responsabilidade por parte dos usuários e desenvolvedores.

A ausência de mecanismos automáticos de verificação torna essencial a implementação de estratégias complementares. Além disso, a confiança excessiva em respostas geradas por IA pode levar a erros críticos, especialmente em áreas sensíveis como saúde, direito e educação.

Portanto, o uso desses modelos deve ser acompanhado de uma abordagem crítica e consciente.

📝 6. Conclusão

Os LLMs locais representam uma alternativa relevante aos modelos baseados em nuvem, oferecendo vantagens significativas em termos de privacidade e autonomia. Contudo, suas limitações, especialmente relacionadas à ocorrência de alucinações e à falta de atualização em tempo real, impõem desafios importantes.

A implementação de estratégias como integração com bases locais, engenharia de prompts e validação humana é fundamental para mitigar esses problemas. Dessa forma, é possível explorar o potencial dos LLMs locais de maneira mais segura e eficiente.

📚 Referências (exemplo acadêmico)

- BENDER, E. M. et al. On the Dangers of Stochastic Parrots. 2021.

- BROWN, T. et al. Language Models are Few-Shot Learners. 2020.

- LEWIS, P. et al. Retrieval-Augmented Generation for Knowledge-Intensive NLP Tasks. 2020.

- OPENAI. GPT Models Documentation.

- GOODFELLOW, I.; BENGIO, Y.; COURVILLE, A. Deep Learning. 2016.